黑盒探秘

周博磊拆解機器學習之謎

疫症當前,我不得不留在家中,與周博磊教授在網上相見。我不太喜歡自己在鏡頭下的樣子,所以視像會議這玩意,我向來是敬而遠之。尚幸近年視像通話科技有所進步,我也不如昔日般拒之於千里之外。

像我這樣疏於打掃的人,每次參加視像會議都要小心翼翼。稍一不慎,鏡頭放錯了位置,家裏的亂狀就要暴露於人前。以往的解決方法,是預先在身後放置一幅綠色布幕。這除了是為遮醜,也是要讓電腦抽取畫面綠色部分,移花接木,換上悅目的虛擬背景。

有賴近年開發的一項的視像處理技術,不靠綠幕,電腦亦能即時從畫面分離出原有背景,偷天換日。除了近日備受關注的Zoom,市面上多款網絡通訊軟件亦已配備此技術。如今我輕按一鍵,便能把身後的烏煙瘴氣遮蓋,換作合一亭的閒雲潭影,豈不美哉?

說這戲法是神蹟,大概亦不為過。上至專家,下至凡人,都是知其然而不知其所以然。周教授正是對此深感興趣,一直嘗試解開當中謎團。

周教授隸屬信息工程學系,專攻人工智能。在人工智能的大千世界,以機器學習這門方興未艾的科技,最令他着迷。

「所謂機器學習,就是令電腦學會理解數據、洞悉箇中玄機。」

要電腦懂得把視像中的背景抽取出來,我們要先向它解釋甚麼是背景。但背景有千萬種,不一而足,要說出一個放諸四海皆準的定義,殊非易事。

機器學習正可解決這問題。與其勞煩自己,費時失事,不如善用電腦自身的高速運算功能,讓它自行理解背景為何物。我們只須找來一堆樣本,讓它好好觀察,它自會領略到當中的規律和法則,藉以辨認出各式各樣的背景。

「機器學習也可用於開發無人駕駛技術。」周教授舉例說。有賴機器學習,電腦的功能與日俱增。小至潤飾影片、與人類對弈,大至操控汽車、為病人斷症,它們一一做到。

這個事事由電腦代勞的世界,看似十分美好,但實情又是否如此?電腦不靠人類,自主學習,引導它們作出各種決定的知識,亦全由自學得來。問題來了:它們學了甚麼、憑藉怎樣的資訊主宰人類日常生活,我們一無所知。

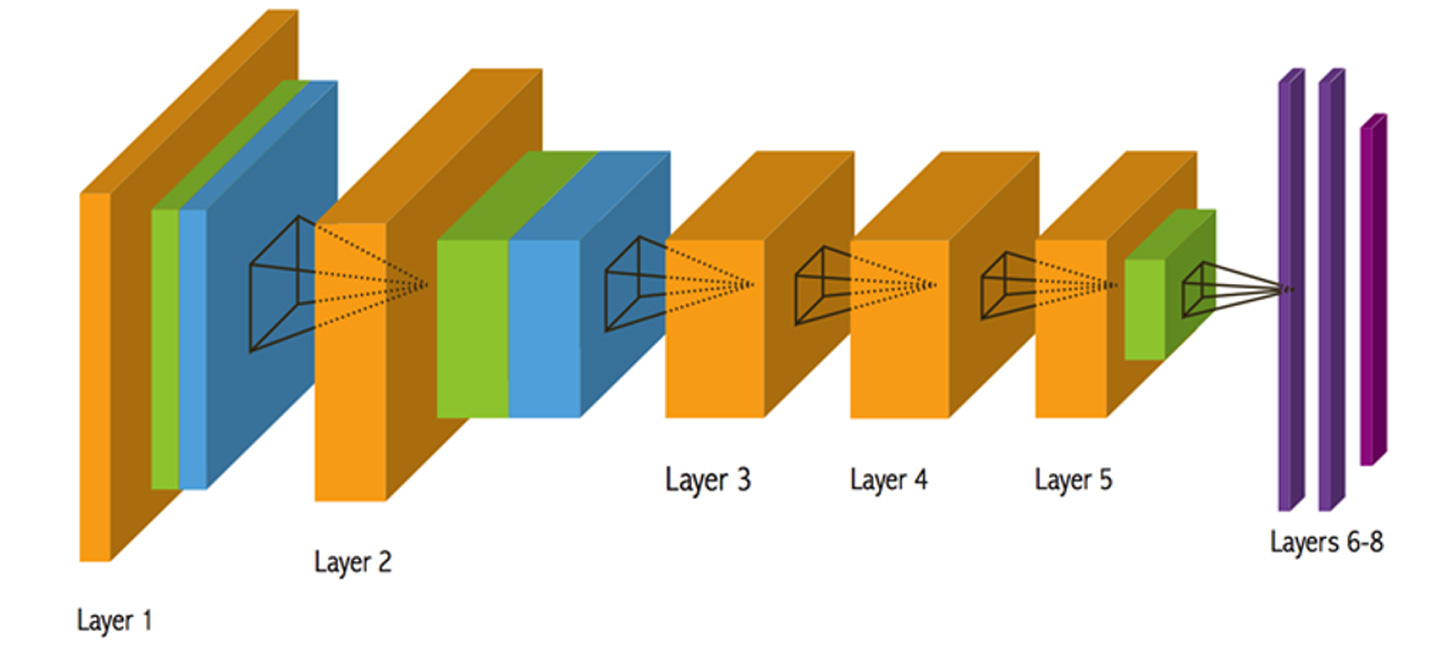

「機器學習牽涉大量的參數和運算子,極難疏理。」周教授解釋。電腦透過觀察學習,這往往要用上數以百萬計的樣本,每個樣本又要經一種名為神經網絡的系統抽絲剝繭,方能為電腦所消化。此過程錯綜複雜,連設計它的程式員也看不透,故有「黑盒」之稱。當然,所謂「設計」其實也不過是為電腦建造學習平台。它們該如何在這平台上學習、學習甚麼,本來就不由程式員控制。

黑盒帶來的影響非同小可。電腦的決策成謎,則其誤將癌症說成良性,甚或胡亂駕駛、橫衝直撞,我們亦無法得知原因、修正錯誤。我們也因黑盒所礙,不能從電腦的學習成果分一杯羹。

「花了人類二千年時間發展的圍棋棋藝,電腦用一星期便能掌握。」周教授說。事實上,人類早已被AlphaGo等電腦程式超越。「我們可以反過來在它們身上學習謀略。」

有見黑盒引發種種問題,周教授亟欲破解迷陣。在中大取得信息工程學碩士學位後,他負笈麻省理工學院,攻讀博士。留美期間,他聯同團隊開發出一套能夠揭示電腦思維的成像法class activation mapping(CAM)。

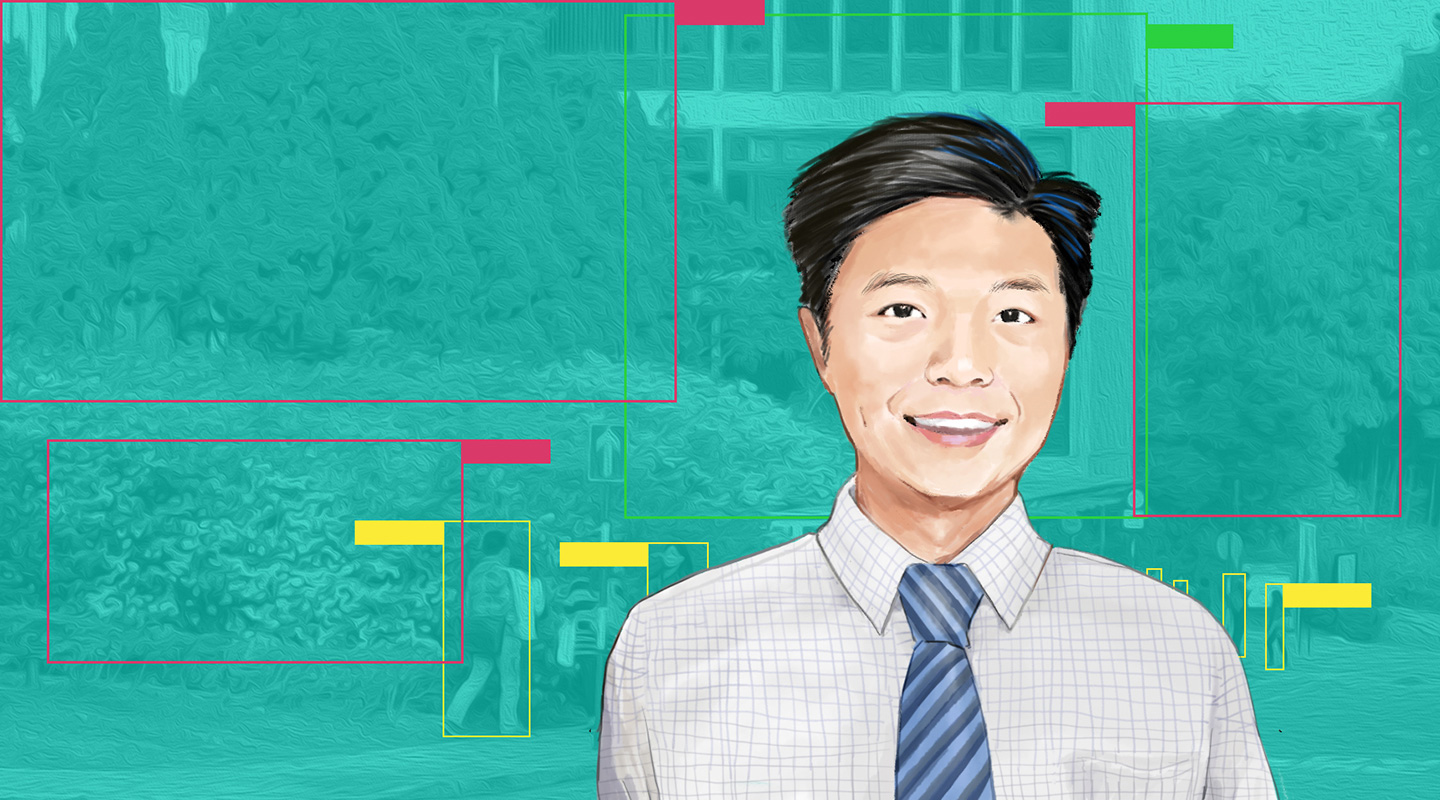

上面提到,現今的電腦只要看過樣本,便能輕易從各種視訊抽取背景。然而,沒有人知道它們以甚麼準則辨認背景,也沒有人知道它們當初是如何從樣本推演出這些準則。CAM可以標示電腦在偵測背景時留意的事物,幫助專家了解它們是在怎樣的基礎上作判斷。

「此成像法可用於追查它們出錯的原因。」周教授說。史丹福大學就有學者以CAM分析肺片,檢視電腦在篩查肺炎時留意的部位和症狀。

修讀博士期間,周教授亦參與研發一套名為network dissection的分析法。利用這項技術,周教授等人發現電腦在理解某場景的性質時如同人腦,一樣會着眼於場景中個別物件。

在人類的概念中,睡房之所以為睡房,是因為當中有床、枕頭之類的物件。我們要判斷一個地方是否睡房,也會留意該處有沒有這樣的東西。電腦的思路也一樣,而這是周教授意想不到的。

「供電腦研習的樣本中,我們僅註明場景的性質,從未標示當中的物件。」周教授說。顯然,影像對電腦來說已不再是一堆雜亂無章的視覺訊號。它們早已自行學會從混沌中辨認出物件的輪廓,過程中完全不需要人類介入。

「它們忽然看得見了。」

周教授於2018年回到中大,繼續探究機器學習之謎。針對電腦如何學會詮釋影像研究多時,他近年轉而探索它們合成人像的機制。

這兩個課題其實同出一轍。要電腦懂得畫圖,我們也是要找來一堆樣本,讓它參透箇中理則,依樣畫葫蘆。周教授與研究生沈宇軍及湯曉鷗教授合作,發現電腦研習人面樣本時不但能縱觀全局,更會留意小處,觀察年齡、性別等較細微的特徵。

幾位學者以此發現為基礎,開創出一套名為InterFaceGAN的人像編輯技術。電腦對個別特徵有所掌握後,我們可以對這些認知作改動,扭轉它們對人面的理解。這樣一來,它們便會基於這些經調整的認知,畫出我們想要的面孔。

有了這項技術,我們便能隨心所欲,修飾自己的相片,就是返老還童也可以。此修圖術巧妙之處,在於其針對單一特徵,不會牽一髮而動全身。

周教授在學術上建樹良多,最近獲《麻省理工科技評論》選為本年度亞太區廿位三十五歲以下的創科人之一。當然,他與一眾學者還要走一段很長的路,才能徹底解開機器學習之謎。

「未來的方向之一,是在設計階段便着手簡化電腦的學習機制。」周教授說。目前的策略是先令電腦學會各種功能,之後才慢慢化繁為簡,釐清其學習過程。周教授談到的方向,將一改這種先易後難的取態。

周教授亦期望與不同領域的學者共事,發揮機器學習的潛能。他有意和機械工程學家聯手,製造出決策更透明、性能更可靠的機械人。他也期待與醫學院的同事合作,運用電腦救治病人。

「中大在研究機器學習方面表現出色,醫學成就更是超卓。但願我們在了解人工智能方面的成果,能夠應用在醫學世界。」他舉例說,機器學習對分析醫療數據大有幫助。

「我們一路走來,說到底還是希望為人群服務。」

Jason Yuen